Sintesi

La Core Reasoning Assessment Suite è una serie innovativa di test di valutazione delle capacità cognitive sviluppata da Deeper Signals per aiutare le organizzazioni a individuare, selezionare e sviluppare i migliori talenti. Composta da tre test adattivi – ragionamento logico, numerico e verbale – la suite offre una valutazione completa delle capacità di ragionamento fondamentali che sono alla base del successo professionale, dell’agilità di apprendimento e del potenziale di leadership.

La capacità di ragionamento è uno dei principali indicatori predittivi delle prestazioni sul posto di lavoro, della capacità di adattamento e della crescita a lungo termine. Decenni di ricerche dimostrano che i dipendenti con livelli più elevati di capacità cognitive non solo ottengono risultati migliori in tutti i ruoli, ma imparano anche più rapidamente, innovano in modo efficace e si adattano alle esigenze in continua evoluzione delle organizzazioni moderne. La Core Reasoning Suite è stata progettata per mettere in pratica questi principi scientifici, fornendo alle organizzazioni informazioni basate su dati concreti per le assunzioni, lo sviluppo professionale, la pianificazione della successione e la progettazione della forza lavoro.

Ogni valutazione della suite è stata sviluppata sulla base degli stessi principi fondamentali:

- Adattivo ed efficiente: somministrato tramite test adattivo computerizzato (CAT), riduce la durata del test mantenendo la precisione della valutazione;

- Equità e accessibilità: progettato per ridurre al minimo i pregiudizi culturali, linguistici e educativi, garantendo l'equità tra le diverse fasce della popolazione;

- Psicometricamente solido: calibrato con i moderni metodi della teoria della risposta all'item (IRT) per garantire affidabilità, validità e accuratezza su tutto lo spettro delle capacità;

- Concreto ed etico: fornisce informazioni utili alle organizzazioni e ai singoli individui, ponendo l'accento sull'uso responsabile e sul rispetto degli standard di settore.

Ragionamento logico

Il Core Logical Reasoning Assessment (CLRA) valuta la capacità di risolvere problemi astratti e di riconoscere schemi attraverso rompicapi non verbali. È stato convalidato su un campione globale di oltre 4.000 partecipanti, dimostrando un’elevata affidabilità, una validità convergente con misure consolidate delle capacità cognitive e l’assenza di effetti negativi legati all’età, al genere e all’etnia. Il CLRA sfrutta la generazione automatica di item per creare algoritmicamente nuovi item di ragionamento a matrice a vari livelli di difficoltà. Questa tecnica consente alla valutazione di evolversi e migliorare nel tempo, ampliando la banca di item e rafforzando l'accuratezza della misurazione ad ogni ricalibrazione.

Ragionamento numerico

Il Core Numerical Reasoning Assessment (CNRA) valuta la capacità di interpretare, analizzare e trarre conclusioni logiche da dati quantitativi, tra cui il ragionamento aritmetico, le serie numeriche e le matrici numeriche. È stata sviluppata una solida banca dati composta da 290 item, nel rispetto di rigorose linee guida in materia di equità e neutralità.

Ragionamento verbale

Il Core Verbal Reasoning Assessment (CVRA) misura la capacità di comprendere, analizzare e valutare le informazioni presentate in forma scritta, con tipi di domande che includono analogie, sillogismi, ragionamento critico, riconoscimento delle ipotesi e valutazione degli argomenti. È stata sviluppata una solida banca dati di 262 domande nel rispetto di rigorose linee guida in materia di equità e neutralità.

Piano d'azione e miglioramento continuo

Sebbene la suite sia già posizionata come un'offerta completa, Deeper Signals si impegna a garantirne la continua verifica e il miglioramento. Tra le iniziative in programma che stiamo valutando figurano:

- Ampliare e ricalibrare i pool di elementi per migliorare la precisione delle misurazioni.

- Ampliare il campione di riferimento per garantire la pertinenza a livello globale e in relazione a ruoli specifici.

- Condurre studi sulla validità concettuale per dimostrare ulteriormente il potere predittivo in relazione alle prestazioni lavorative e ad altri concetti organizzativi fondamentali.

- Effettuare regolarmente verifiche di equità per garantire che le valutazioni siano prive di pregiudizi e di effetti negativi.

Introduzione al ragionamento di base

Core Reasoning è una suite di valutazioni adattive progettata per misurare le capacità cognitive, ovvero la capacità di analizzare problemi nuovi, riconoscere schemi ricorrenti, pensare in modo critico e risolvere compiti complessi. Le capacità cognitive sono tra i fattori predittivi più significativi delle prestazioni lavorative, dell’agilità di apprendimento e dell’adattabilità nei contesti lavorativi moderni e dinamici (Chamorro-Premuzic & Furnham, 2010; Sackett et al., 2022). A differenza delle conoscenze o delle competenze specifiche di un ruolo, la capacità di ragionamento è ampiamente applicabile a diversi lavori, settori e livelli di carriera.

La scienza del ragionamento

La ricerca meta-analitica dimostra costantemente che le capacità cognitive sono tra i fattori predittivi più significativi del successo professionale, inclusi le prestazioni lavorative, il raggiungimento di posizioni di rilievo, il successo formativo e l’efficacia della leadership (Schmidt & Hunter, 1998; Judge, Colbert, & Ilies, 2004; Sackett, Zhang, Berry, & Lievens, 2022). Nello specifico, le capacità cognitive sono correlate positivamente alle prestazioni lavorative in quasi tutti i tipi di lavoro, con coefficienti di validità che variano tipicamente tra 0,50 e 0,65. Questa relazione rimane forte anche dopo aver controllato altri fattori quali l’esperienza e l’istruzione (Schmidt & Hunter, 1998; Sackett et al., 2022).

La suite Core Reasoning è stata progettata per valutare direttamente questa capacità attraverso tre ambiti complementari: ragionamento logico, ragionamento numerico e ragionamento verbale.

Il ragionamento logico consiste in item astratti e non verbali, concepiti per ridurre al minimo i pregiudizi culturali e linguistici, misurando al contempo con precisione la capacità di risolvere problemi. Ispirata alle Matrici Progressive di Raven, la valutazione si concentra sul riconoscimento di schemi e sul ragionamento basato su regole in un formato puramente visivo. Gli item si suddividono in due ambiti principali:

- Ragionamento induttivo e deduttivo: valutazione della capacità di individuare schemi logici, applicare regole e risolvere problemi nuovi senza fare affidamento su conoscenze pregresse.

- Ragionamento visivo-spaziale: valutazione dell'efficacia con cui gli individui interpretano e manipolano le informazioni visive, identificano le relazioni spaziali e generalizzano su modelli astratti.

Il ragionamento numerico comprende domande quantitative volte a valutare il modo in cui gli individui elaborano, interpretano e ragionano sulle informazioni numeriche. La valutazione privilegia le operazioni logiche rispetto al semplice calcolo meccanico, garantendo che i risultati riflettano la capacità di ragionamento piuttosto che la preparazione matematica pregressa. Le domande si articolano in due ambiti principali:

- Risoluzione quantitativa di problemi: valutazione della capacità di trarre conclusioni logiche da schemi numerici, serie di numeri ed esercizi di ragionamento aritmetico.

- Interpretazione dei dati: valutazione della capacità di analizzare grafici, tabelle e informazioni quantitative strutturate per individuare tendenze e trarre conclusioni fondate.

Il ragionamento verbale comprende domande basate sul linguaggio, pensate per valutare la capacità di ragionare sulla base di materiale scritto, riducendo al minimo l'influenza dell'ampiezza del vocabolario o delle conoscenze culturali. La valutazione si concentra sul pensiero critico applicato alle informazioni verbali, garantendo l'equità attraverso un linguaggio semplice e contenuti neutri dal punto di vista contestuale. Le domande si articolano in due ambiti principali:

- Ragionamento analitico basato sul linguaggio: valutazione della capacità di riconoscere relazioni, trarre conclusioni logiche e valutare argomentazioni sulla base di testi scritti.

- Ragionamento deduttivo e critico: valutazione della capacità di individuare i presupposti, verificare la validità delle conclusioni e interpretare o contestare le argomentazioni.

Nel loro insieme, queste valutazioni offrono una visione d'insieme della capacità di una persona di elaborare le informazioni, prendere decisioni ponderate e apprendere rapidamente in situazioni nuove.

Perché il ragionamento è importante per le organizzazioni

Nelle organizzazioni moderne, i dipendenti devono adattarsi alle nuove tecnologie, a dati complessi e a modelli di business in continua evoluzione. I dirigenti, in particolare, devono prendere decisioni rapide sulla base di informazioni incomplete, spesso sotto pressione. La capacità di ragionamento è alla base di:

- Acquisizione e selezione del personale: consente di effettuare assunzioni basate su dati concreti, individuando i candidati dotati delle capacità cognitive necessarie per avere successo in ruoli complessi.

- Sviluppo dei dipendenti: individua i punti di forza e le aree di miglioramento relative al ragionamento e al pensiero critico, orientando iniziative personalizzate di formazione e coaching.

- Pianificazione della successione: aiuta le organizzazioni a individuare i dipendenti ad alto potenziale in grado di gestire una maggiore complessità e di assumere ruoli dirigenziali.

- Efficacia del team: migliora la comprensione della diversità cognitiva all'interno dei team, favorendo una migliore risoluzione dei problemi e l'innovazione attraverso una composizione strategica del team.

- Pianificazione strategica della forza lavoro: fornisce analisi predittive per prevedere e gestire il flusso di talenti, facilitando il processo decisionale strategico in materia di competenze, esigenze formative e investimenti nel talento.

Perché Core Reasoning è diverso

La suite Core Reasoning è stata progettata non solo per misurare le capacità cognitive, ma anche per farlo in modo moderno, etico e sostenibile. Diverse caratteristiche la distinguono dai tradizionali test di ragionamento:

adattivo e coinvolgenteI tradizionali test di ragionamento sono spesso lunghi, statici e frustranti per i candidati, con domande che possono risultare troppo facili o incredibilmente difficili. Le valutazioni Core Reasoning utilizzano invece il Computerized Adaptive Testing (CAT), che regola dinamicamente la difficoltà delle domande durante tutta la valutazione per adattarla alle capacità stimate di ciascun candidato. Questo approccio, basato sulla Teoria della Risposta all'Item (IRT), massimizza la precisione della misurazione a tutti i livelli di abilità, riducendo al contempo la durata del test a non più di 15 minuti per ogni valutazione. I candidati vengono messi alla prova in modo adeguato, la fatica è ridotta al minimo e i punteggi risultanti sono accurati ed equi.

Equità e accessibilitàdell’

I tradizionali test di ragionamento sono stati spesso criticati per i pregiudizi culturali o educativi in essi insiti. La suite Core Reasoning è stata progettata ponendo l’equità al primo posto: le domande sono redatte in un linguaggio semplice e neutro, sottoposte a screening per il funzionamento differenziale degli item (DIF) e verificate in base alla regola dei quattro quinti per monitorare eventuali impatti negativi. Gli standard di accessibilità, quali la compatibilità con gli screen reader, il contrasto e la leggibilità, sono integrati nella progettazione. Queste misure di salvaguardia garantiscono che le differenze di punteggio osservate riflettano le reali capacità piuttosto che fattori culturali o linguistici irrilevanti.

Rigorosità scientifica

La suite Core Reasoning è calibrata utilizzando moderni modelli psicometrici, in particolare il modello IRT logistico a due parametri (2PL). Questo modello stima sia la difficoltà che la discriminanza degli item, garantendo stime accurate delle abilità (theta) e metriche di affidabilità significative. Gli errori standard vengono monitorati a livello individuale, fornendo intervalli di confidenza relativi ai punteggi. In combinazione con il CAT, ciò garantisce che ogni punteggio riportato ai clienti sia preciso e difendibile, anche quando basato su un numero di item inferiore rispetto ai test tradizionali.

: innovativo e in continua evoluzioneA differenza delle valutazioni statiche con banche di item fisse, Core Reasoning integra la generazione automatica di item (nel ragionamento logico) e la calibrazione assistita dall’intelligenza artificiale (nelle sezioni verbale e numerica). Ad esempio, regole algoritmiche generano problemi a matrice in stile Raven su tutta la gamma di difficoltà, consentendo alla banca di item di espandersi continuamente. Questa innovazione riduce i rischi legati all’esposizione degli item e garantisce la sicurezza dei contenuti del test, mentre le simulazioni e le ricalibrazioni mantengono una precisione di misurazione costante nel tempo.

: strumenti pratici ed eticiCore Reasoning è stato progettato pensando agli utenti finali. I risultati vengono tradotti in punteggi percentili standardizzati e in chiari intervalli interpretativi, fornendo alle organizzazioni informazioni basate su dati concreti per le assunzioni, lo sviluppo dei dipendenti e la pianificazione della forza lavoro. Tutte le valutazioni sono sviluppate e validate in linea con le linee guida dell’EEOC e le migliori pratiche internazionali, garantendo che le organizzazioni possano prendere decisioni efficaci e eticamente sostenibili.

Sviluppo e metodologia della valutazione

La suite Core Reasoning è stata sviluppata per coniugare il rigore scientifico con un'esperienza intuitiva per i candidati. Ogni valutazione segue una filosofia progettuale coerente, fondata sulle migliori pratiche psicometriche e sugli standard di equità organizzativa.

Sviluppo dei prodotti

La suite Core Reasoning è stata progettata per ridurre al minimo i pregiudizi culturali e demografici che storicamente hanno limitato l'equità delle valutazioni cognitive. La ricerca dimostra che i test di abilità tradizionali possono inavvertitamente svantaggiare determinati gruppi, riducendo l'equità e limitando la validità delle interpretazioni (Sackett et al., 2022). Per ovviare a questo problema, gli item sono stati sviluppati secondo rigorosi standard di equità e neutralità:

- Fidelità concettuale: gli item sono concepiti per misurare direttamente la capacità di ragionamento, evitando interferenze dovute all’ampiezza del vocabolario, alle conoscenze culturali o al livello di istruzione.

- Livello di difficoltà: le banche di domande comprendono contenuti che spaziano da livelli molto facili a livelli molto difficili, consentendo una valutazione accurata dell'intero spettro di abilità.

- Equità e neutralità: le domande vengono sottoposte a una revisione da parte di esperti e a test pilota per verificare il funzionamento differenziale delle domande (DIF) in base al genere, all’età e all’etnia, garantendo che le differenze di punteggio osservate riflettano le reali capacità.

- Aggiornamento continuo: la generazione automatica delle domande (Ragionamento logico) e lo sviluppo assistito dall'intelligenza artificiale (Numerico e Verbale) consentono alle banche dati delle domande di ampliarsi e aggiornarsi regolarmente, riducendo i rischi di esposizione e migliorando la sicurezza.

Valutazione, calibrazione e progettazione adattiva dei test

Tutte le valutazioni di Core Reasoning si basano sui moderni principi della teoria della risposta all'item (IRT) e dei test adattivi computerizzati (CAT), garantendo una valutazione precisa, efficiente ed equa delle capacità di ragionamento.

Calibrazione della teoria della risposta all'item

La valutazione CRLA viene calibrata utilizzando un modello IRT logistico a due parametri (2PL), che stima sia la difficoltà dell'item (β) sia la discriminanza (α):

- Discriminazione (α): indica l'efficacia con cui un item distingue tra individui con diversi livelli di abilità.

- Difficoltà (β): indica il livello di abilità necessario per avere il 50% di probabilità di risolvere correttamente la domanda.

Le valutazioni di ragionamento numerico e verbale sono state calibrate utilizzando un modello IRT logistico a 1 parametro (1PL; Rasch), che stima la difficoltà dell’item (β) fissando la discriminanza (α) a 1 per tutti gli item. Questo approccio è stato scelto perché, trattandosi di valutazioni più recenti con campioni di calibrazione più ridotti, la nostra priorità principale era quella di stabilire stime di difficoltà robuste e interpretabili nell’ambito delle banche di item. Il modello 1PL fornisce una calibrazione stabile e conservativa in queste condizioni, garantendo un punteggio equo e coerente mentre i campioni di validazione sono ancora in crescita. Man mano che saranno disponibili dati più ampi e diversificati derivanti dall'utilizzo da parte dei clienti, queste valutazioni saranno ricalibrate utilizzando modelli 2PL o a parametri superiori per catturare sia la difficoltà che la discriminazione con maggiore precisione.

La calibrazione viene effettuata utilizzando algoritmi di tipo Expectation-Maximization, che forniscono stime accurate dei parametri che riflettono i costrutti sottostanti oggetto di misurazione. Ciò consente a ogni item di fornire informazioni significative sulle capacità di ragionamento di un candidato e garantisce che i punteggi siano affidabili e interpretabili. La scelta del modello logistico a 2 parametri (2PL) è supportata da un'ampia ricerca che ne dimostra l'efficacia nei test delle capacità cognitive e nella somministrazione adattiva (Embretson & Reise, 2000; Rust, Kosinski, & Stillwell, 2021; van der Linden, 2016).

Progettazione adattiva dei test

La suite Core Reasoning utilizza la tecnologia CAT per personalizzare ogni valutazione in base al singolo candidato. La somministrazione adattiva seleziona dinamicamente le domande in base alle risposte precedenti, regolando la difficoltà delle domande in tempo reale per adattarla alle capacità stimate. Questo approccio:

- Ottimizza la precisione somministrando domande che forniscono le informazioni più significative in base al livello di competenza del candidato.

- Riduce la durata del test e l'affaticamento; in genere bastano meno di 15 minuti per completarlo.

- Garantisce un'esperienza più equa, evitando sequenze di elementi troppo facili o troppo difficili per un determinato utente.

Tra le caratteristiche principali della metodologia adattiva figurano:

- Criterio di selezione degli elementi: gli elementi vengono selezionati utilizzando il metodo dell'informazione massima di Fisher, ottimizzando l'accuratezza delle stime delle abilità.

- Controllo dell'esposizione: si ricorre ad approcci quali il metodo Sympson-Hetter per trovare un equilibrio tra la precisione delle misurazioni e la sicurezza della banca dei test.

- Stopping Rules: Assessments terminate when measurement precision reaches a defined threshold (e.g., standard error < 0.35) or when a maximum of 30 items have been administered, balancing reliability with efficiency.

Equità e valutazione dell'impatto negativo

Garantire l'equità è fondamentale nella progettazione e nell'utilizzo della suite Core Reasoning. La ricerca dimostra che le valutazioni delle capacità cognitive, se non progettate con cura, possono inavvertitamente penalizzare determinati gruppi demografici, limitando sia l'equità che la validità delle interpretazioni (Sackett et al., 2022). Per ovviare a questo problema, le considerazioni relative all'equità sono state integrate in ogni fase dello sviluppo, dalla stesura degli item alla calibrazione su larga scala. Tutte le valutazioni della suite Core Reasoning sono sottoposte a:

- Analisi del funzionamento differenziale degli item (DIF) in base all'età, al sesso e all'etnia.

- Monitoraggio degli impatti negativi, comprese simulazioni basate sulla regola dei quattro quinti per garantire la conformità alle linee guida in materia di occupazione (ad es. EEOC) e confronti tra gruppi a livello di item e di scala.

- Valutazioni dell'accessibilità, tra cui la compatibilità con i lettori di schermo, la leggibilità in un linguaggio semplice e l'assenza di pregiudizi nei contenuti.

Interpretazione dei punteggi CRA e applicazione etica

Ciascuna delle scale di valutazione del rischio (CRA) fornisce un punteggio percentile, che consente di confrontare le prestazioni di un individuo con quelle di un gruppo di riferimento.

- Punteggi bassi (al di sotto del 33° percentile): le persone che rientrano in questa fascia potrebbero trovare più impegnativi i ruoli che richiedono una rapida capacità di apprendimento, processi decisionali complessi o la risoluzione di problemi astratti. Tuttavia, potrebbero dare il meglio di sé in ruoli che privilegiano processi strutturati, routine costanti e attenzione ai dettagli, dove l'affidabilità e la costanza rappresentano i punti di forza principali.

- Punteggi medi (dal 33° al 66° percentile): le persone che si collocano nella fascia percentuale intermedia dimostrano una capacità di ragionamento ben sviluppata e affidabile nell’affrontare compiti di risoluzione di problemi verbali, numerici e astratti. Sono generalmente in grado di comprendere nuove informazioni, applicare regole logiche ed esprimere giudizi fondati in situazioni strutturate o moderatamente complesse. Sebbene possano impiegare più tempo ad adattarsi a situazioni altamente ambigue o in rapido cambiamento rispetto a chi ottiene punteggi più alti, mostrano tipicamente prestazioni costanti, buon giudizio e un apprendimento affidabile man mano che l'esperienza e il contesto aumentano.

- Punteggi elevati (superiori al 66° percentile): le persone che rientrano in questa fascia dimostrano in genere ottime capacità di ragionamento, adattabilità e rapidità di apprendimento. Spesso danno il meglio di sé in contesti dinamici o complessi che richiedono flessibilità, innovazione e capacità di risolvere i problemi. Per mantenere vivo il loro interesse, potrebbero trarre beneficio da compiti stimolanti, opportunità di crescita e ambienti che incoraggiano il pensiero analitico.

È importante interpretare i punteggi CRA in modo responsabile e tenendo conto del contesto. I punteggi non dovrebbero essere utilizzati isolatamente per prendere decisioni in materia di assunzioni, a meno che non siano stati condotti rigorosi studi di validazione a livello locale e di impatto negativo. Deeper Signals può collaborare con le organizzazioni per svolgere tali studi.

Le organizzazioni che utilizzano queste valutazioni devono garantire il rispetto delle linee guida dell'EEOC ed evitare pratiche discriminatorie, verificando regolarmente se i risultati abbiano un impatto negativo sui vari gruppi demografici. Sebbene non siano richiesti studi di validità per gli strumenti che non mostrano alcun impatto negativo sui gruppi protetti, è buona norma continuare a raccogliere nel tempo prove a sostegno della validità concettuale e della validità di criterio. Deeper Signals raccomanda di testare le valutazioni in fase pilota e di raccogliere dati a livello locale prima di applicarle alle decisioni relative alla selezione e allo sviluppo del personale.

Deeper Signals si impegna inoltre a garantire la responsabilità algoritmica, effettuando verifiche periodiche dei propri modelli di valutazione per assicurarsi che rispettino gli standard del settore in materia di affidabilità, validità ed equità.

Quando si utilizzano i punteggi CRA nel processo decisionale relativo alle risorse umane, si raccomanda di ricorrere a punteggi normati per facilitare l'interpretazione e il confronto. Come linea guida generale, è possibile utilizzare una soglia al 25° percentile per trovare un equilibrio tra la necessità di identificare le persone con i punteggi più bassi e la riduzione del rischio di effetti negativi. Tuttavia, le soglie di punteggio dovrebbero sempre basarsi sull'analisi delle mansioni e su studi di validazione locali, al fine di garantire che nella pratica venga applicato il profilo più adeguato. È importante sottolineare che i punteggi bassi non implicano un comportamento negativo, improduttivo o dannoso: riflettono semplicemente diversi punti di forza e capacità.

Proprietà psicometriche delle valutazioni del ragionamento di base

Ragionamento logico

La valutazione del ragionamento logico di base (CRLA) viene effettuata tramite compiti di ragionamento astratto ispirati alle Matrici Progressive di Raven, che valutano la capacità di individuare schemi e risolvere problemi nuovi attraverso stimoli visivi non verbali (Raven, Raven e Court, 1998). Queste matrici sono ampiamente riconosciute come il gold standard grazie alla loro elevata validità e alla scarsa suscettibilità ai pregiudizi culturali. Gli item sono volutamente non verbali per ridurre al minimo i pregiudizi culturali e linguistici. La valutazione copre due ambiti principali:

- Ragionamento induttivo e deduttivo: la capacità di individuare e applicare regole logiche in contesti nuovi.

- Ragionamento visivo-spaziale: la capacità di interpretare informazioni visive astratte e di riconoscere le relazioni spaziali.

Una caratteristica distintiva del CLRA è l’uso della generazione automatica di item nella progettazione della banca di item iniziale. Regole algoritmiche definiscono le modalità di costruzione dei problemi di ragionamento in stile matrice, consentendo la creazione di nuovi item in un ampio intervallo di difficoltà. Tali regole si basano sui risultati di Carpenter et al. (1990), che hanno definito una tassonomia relativa alle modalità di costruzione delle matrici progressive. Questa innovazione garantisce che la banca dei test possa essere continuamente aggiornata, riducendo i rischi di esposizione degli item e mantenendo equità e precisione nel tempo.

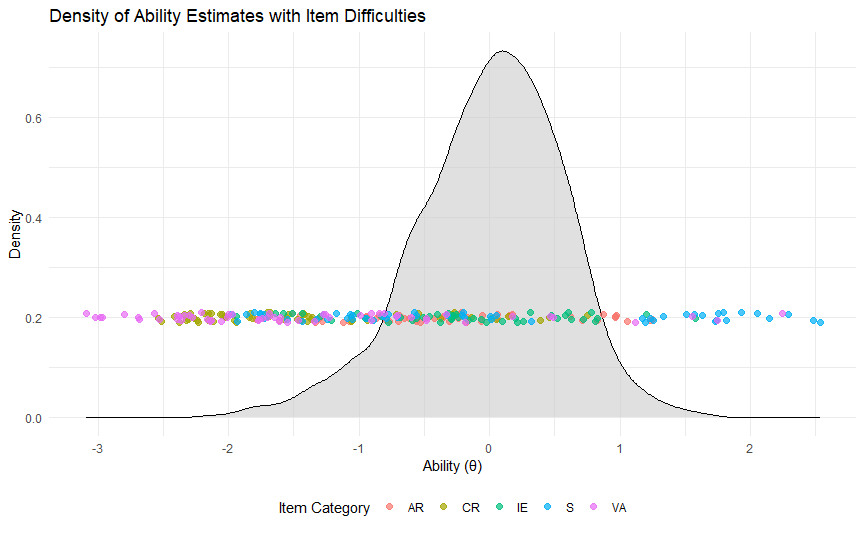

Per garantire una calibrazione e una validazione affidabili, il CLRA è stato sottoposto a approfonditi test empirici. La fase iniziale di raccolta dati ha prodotto 11.284 risposte candidate, con una media di circa 12,5 domande per partecipante. Dopo aver filtrato le risposte in base a criteri rigorosi (come il numero minimo di domande a cui rispondere e la durata accettabile della valutazione), è rimasto un campione finale di calibrazione di 4.410 partecipanti. Questo campione è stato raccolto da una popolazione globale di persone di età compresa tra i 18 e i 60 anni e viene utilizzato per calcolare i punteggi percentili delle abilità (noti anche come punteggi theta).

Interpretazione dei punteggi CLRA

Il CLRA fornisce punteggi percentili, consentendo di confrontare le prestazioni di un individuo con quelle di un gruppo di riferimento.

- Punteggi bassi (al di sotto del 33° percentile): le persone che rientrano in questa fascia potrebbero trovare più impegnativi i compiti di ragionamento induttivo e deduttivo, come il riconoscimento di schemi astratti, l’elaborazione di conclusioni logiche o la generalizzazione di regole a nuovi problemi. Potrebbero inoltre avere difficoltà a elaborare informazioni visuo-spaziali complesse sotto pressione. Tuttavia, potrebbero ottenere buoni risultati in ruoli strutturati in cui i compiti sono costanti, le regole sono esplicite e l’attenzione ai dettagli è molto apprezzata.

- Punteggi medi (dal 33° al 66° percentile): le persone che ottengono punteggi nella fascia percentuale intermedia dimostrano una capacità di ragionamento solida e affidabile. Sebbene possano impiegare più tempo ad adattarsi a situazioni altamente complesse o ambigue rispetto a chi ottiene punteggi più alti, in genere mostrano prestazioni costanti, buon senso e una capacità di apprendimento affidabile quando vengono fornite loro un contesto adeguato, una guida e l’esperienza necessaria

- Punteggi elevati (superiori al 66° percentile): le persone che rientrano in questa fascia eccellono in genere nell’individuare schemi complessi, nell’applicare il ragionamento logico a situazioni nuove e nell’interpretare informazioni visive astratte in modo rapido e accurato. Sono in grado di dare il meglio di sé in ruoli che richiedono flessibilità nella risoluzione dei problemi, rapidità di apprendimento e capacità di adattamento a contesti dinamici o ambigui. Queste persone potrebbero trarre beneficio dall’assegnazione di compiti stimolanti e variegati che consentano loro di mettere a frutto i propri punti di forza nel ragionamento.

Proprietà psicometriche

Gli item del CLRA presentavano un ampio spettro di valori di difficoltà e discriminazione, riflettendo la scelta progettuale di coprire un’ampia gamma di abilità cognitive. Il parametro di difficoltà (β) variava da -1,88 a +4,17, il che significa che il test include sia item relativamente facili che altamente impegnativi. I valori di discriminazione (α) variavano da 0,23 a 2,31, indicando la diversa capacità degli item di distinguere tra individui con diverse abilità di ragionamento.

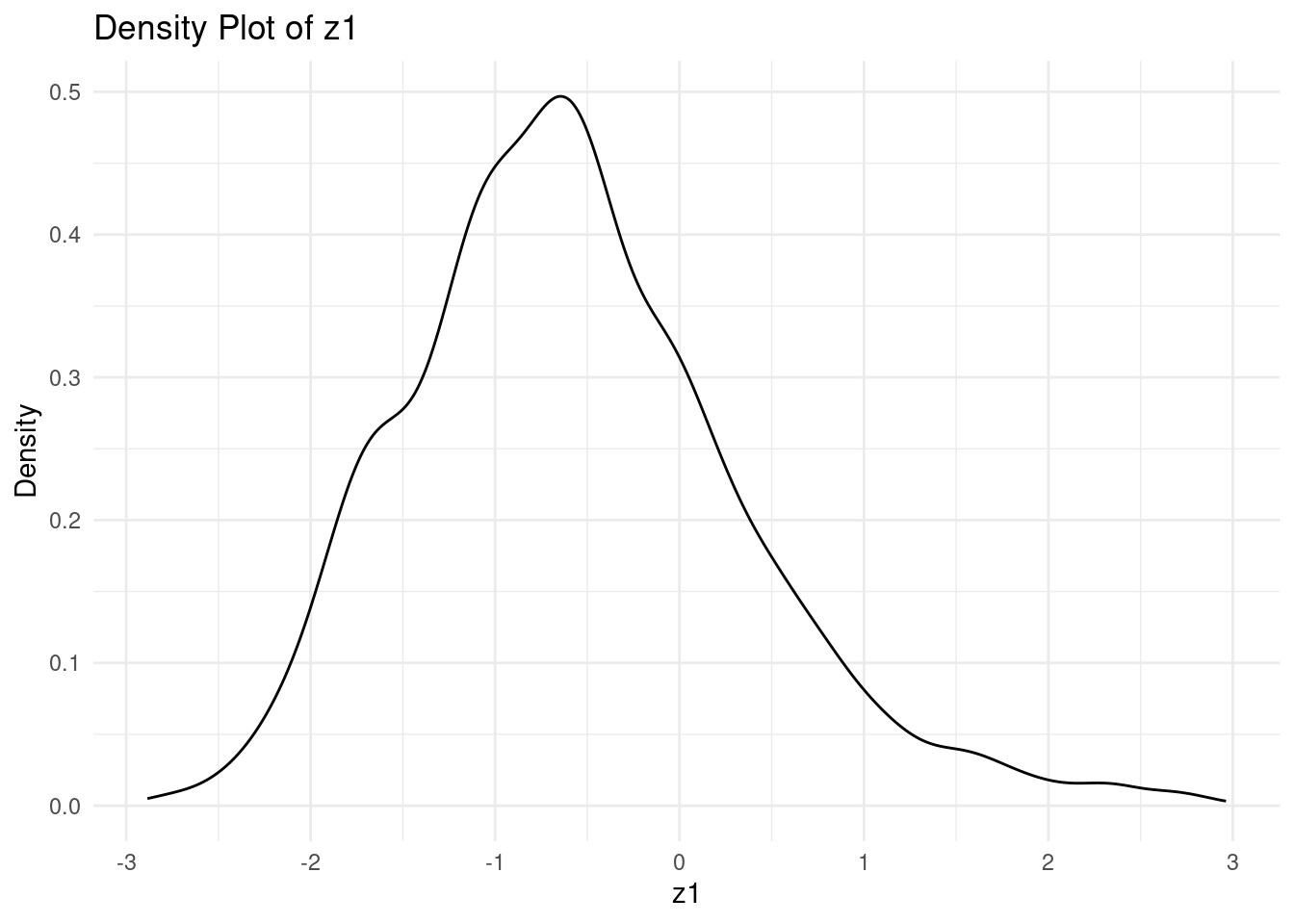

I punteggi theta del CLRA variavano da -2,886 a 2,960, con una media di -0,575 e una deviazione standard di 0,904. La distribuzione presentava una leggera asimmetria negativa, indicando che la maggior parte dei partecipanti ha ritenuto la valutazione moderatamente impegnativa ma accessibile, pur coprendo un ampio spettro di abilità (cfr. la Fig. 1 per la distribuzione dei punteggi theta)

Fig. 1. Grafico di densità dei punteggi theta del CLRA

Per valutare la struttura sottostante del CLRA, è stata condotta un'analisi fattoriale esplorativa. L'analisi ha rivelato che il test è meglio descritto da una struttura fattoriale unidimensionale. Questo risultato è in linea con le aspettative teoriche, poiché il CLRA è stato progettato per misurare un unico costrutto latente: la capacità di ragionamento logico. L'ipotesi di unidimensionalità è ulteriormente avvalorata dal grafico scree plot, che ha mostrato un chiaro punto di inflessione dopo il primo fattore, e dall'analisi degli autovalori.

Ragionamento numerico

Il Core Numerical Reasoning Assessment (CNRA) misura la capacità di interpretare, analizzare e trarre conclusioni logiche da informazioni quantitative. È concepito per valutare il ragionamento fluido con i numeri, concentrandosi sulla risoluzione dei problemi e sull'inferenza logica piuttosto che sul calcolo meccanico. La valutazione copre due ambiti principali:

- Risoluzione quantitativa di problemi: la capacità di applicare il ragionamento aritmetico a problemi strutturati (ad esempio, percentuali, rapporti, problemi verbali).

- Ragionamento logico-quantitativo: la capacità di individuare schemi e regole in serie numeriche o matrici numeriche, che richiede un ragionamento induttivo e deduttivo sulla base di stimoli numerici.

Interpretazione dei punteggi CNRA

- Punteggi bassi (al di sotto del 33° percentile): le persone che rientrano in questa fascia potrebbero trovare più impegnativi la risoluzione di problemi numerici e il ragionamento quantitativo astratto. Potrebbero avere difficoltà a individuare regole nascoste nelle sequenze numeriche o a interpretare i dati in condizioni di tempo limitato, ma possono eccellere in compiti più strutturati, di routine e che non richiedono frequenti deduzioni quantitative.

- Punteggi medi (dal 33° al 66° percentile): gli individui che si collocano nella fascia percentuale intermedia dimostrano una solida capacità di ragionamento numerico. Sono generalmente in grado di elaborare con precisione informazioni quantitative familiari, riconoscere schemi semplici e trarre conclusioni logiche da dati numerici strutturati. Sebbene possano risultare più lenti o meno sicuri di sé rispetto a chi ottiene punteggi più alti quando si trovano di fronte a problemi quantitativi altamente complessi, astratti o con limiti di tempo, mostrano in genere prestazioni affidabili e un miglioramento costante con la pratica e il supporto contestuale.

- Punteggi elevati (superiori al 66° percentile): le persone che rientrano in questa fascia di punteggio eccellono in genere nel trarre conclusioni logiche da informazioni numeriche, nell’individuare schemi ricorrenti e nel risolvere in modo efficiente problemi quantitativi. Sono in grado di dare il meglio di sé in ruoli basati sui dati che richiedono un’interpretazione rapida e accurata di numeri, dati finanziari o operativi e un approccio strutturato alla risoluzione dei problemi.

Per garantire una calibrazione e una convalida affidabili, il CNRA è stato sottoposto a una serie di test empirici approfonditi. La raccolta iniziale dei dati ha prodotto 2734 risposte candidate. Questo campione è stato raccolto tra una popolazione globale di persone di età compresa tra i 18 e i 60 anni e viene utilizzato per calcolare i punteggi percentili relativi alle capacità (noti anche come punteggi theta).

Proprietà psicometriche

Il CNRA dispone di una banca dati di 256 item, che presentano un ampio spettro di valori di difficoltà e discriminazione, riflettendo la scelta progettuale di coprire un'ampia gamma di abilità cognitive. La validazione iniziale della valutazione CNRA è stata effettuata utilizzando un modello logistico a parametro singolo (1PL), in cui la discriminazione è fissata a alfa = 1 per tutti gli item, come modello semplificato data la dimensione del campione utilizzato per la validazione degli item. Il parametro di difficoltà (β) variava da -3,32 a +3,51, il che significa che il test include sia domande molto facili che molto impegnative.

I punteggi theta del CNRA variavano da -3,11 a 2,94, con una media di 0,001 e una deviazione standard di 1,04. La distribuzione presentava una leggera asimmetria negativa, indicando che la maggior parte dei partecipanti ha ritenuto la valutazione moderatamente impegnativa ma accessibile, con un'ampio spettro di abilità coperto dalla valutazione stessa.

Ragionamento verbale

Concetto di ragionamento verbale

Il Core Verbal Reasoning Assessment (CVRA) misura la capacità di comprendere, analizzare e valutare argomentazioni e informazioni scritte. Si concentra sul ragionamento fluido attraverso il linguaggio, evitando di fare eccessivo affidamento sul vocabolario o sulle conoscenze culturali. La valutazione copre cinque ambiti principali:

- Analogie verbali: misurare il ragionamento relazionale attraverso l'individuazione delle relazioni logiche tra coppie di parole.

- Sillogismi: analisi della logica deduttiva attraverso la valutazione della validità delle conclusioni basate sulle premesse.

- Ragionamento critico e deduzione: trarre conclusioni logiche da brevi brani.

- Riconoscimento dei presupposti: individuare i presupposti non espressi necessari affinché le argomentazioni siano valide.

- Valutazione degli argomenti: valutare la validità degli argomenti, individuare i punti deboli e interpretare le prove.

Interpretazione dei punteggi CVRA

- Punteggi bassi (al di sotto del 33° percentile): le persone che rientrano in questa fascia potrebbero avere maggiori difficoltà a valutare argomentazioni, individuare presupposti o trarre conclusioni da testi scritti. Potrebbero ottenere risultati migliori in ruoli che prevedono compiti strutturati e che richiedono un minore ricorso al ragionamento verbale complesso.

- Punteggi medi (dal 33° al 66° percentile): le persone che ottengono punteggi nella fascia percentuale intermedia dimostrano una solida capacità di ragionamento verbale. In genere sono in grado di comprendere le informazioni scritte, seguire il filo del ragionamento e trarre conclusioni ragionevoli dal testo, in particolare quando le idee sono espresse chiaramente e strutturate in modo logico. Sebbene possano avere qualche difficoltà in più rispetto a chi ottiene punteggi più alti con argomentazioni altamente astratte, sottili errori logici o un linguaggio ambiguo, in genere mostrano un giudizio affidabile e un miglioramento costante man mano che aumenta la familiarità con il contesto o l’argomento.

- Punteggi elevati (superiori al 66° percentile): le persone che ottengono punteggi in questa fascia eccellono in genere nell'analisi degli argomenti, nell'individuazione di errori logici e nel formulare giudizi ragionati sulla base di testi scritti. Hanno buone probabilità di avere successo in ruoli che richiedono pensiero critico, capacità decisionali o capacità comunicative di leadership.

Per garantire una calibrazione e una validazione affidabili, il CNRA è stato sottoposto a una serie di test empirici approfonditi. La raccolta iniziale dei dati ha prodotto 1609 risposte candidate. Questo campione è stato raccolto tra una popolazione globale di persone di età compresa tra i 18 e i 60 anni e viene utilizzato per calcolare i punteggi percentili relativi alle capacità (noti anche come punteggi theta).

Proprietà psicometriche

La banca dati di item del CVRA era composta da 240 item, che presentavano un ampio spettro di valori di difficoltà e discriminazione, riflettendo la scelta progettuale di coprire un’ampia gamma di abilità cognitive. La validazione iniziale della valutazione CVRA è stata effettuata utilizzando un modello logistico a parametro singolo (1PL), in cui la discriminazione è fissata a alfa = 1 per tutti gli item, come modello semplificato data la dimensione del campione disponibile per la validazione degli item. Il parametro di difficoltà del CVRA (β) variava da -3,09 a +2,53, il che significa che il test include sia item relativamente facili che altamente impegnativi.

I punteggi theta del CVRA variavano da -2,13 a +1,657, con una media di 0,0 e una deviazione standard di 0,566. La distribuzione presentava una leggera asimmetria negativa, indicando che la maggior parte dei partecipanti ha ritenuto la valutazione moderatamente impegnativa ma accessibile, pur coprendo un ampio spettro di abilità (cfr. la Fig. 3 per la distribuzione dei punteggi theta)

Fig. 3. Grafico di densità dei punteggi theta del CVRA

Studi sulla valutazione delle capacità di ragionamento di base

Studi sulla validità convergente

Le prove a sostegno della validità convergente sono state ottenute mettendo in correlazione i punteggi della valutazione Core Reasoning con quelli dell’International Cognitive Logical reasoning Ability Resource (ICAR-16; Condon & Revelle, 2014), uno strumento ampiamente utilizzato per la misurazione delle capacità cognitive. In un sottocampione di 655 partecipanti che hanno completato le valutazioni Core Reasoning e ICAR, i punteggi theta del CLRA hanno dimostrato una forte correlazione positiva con i punteggi ICAR-16 (vedi Tabella 1). Questa correlazione significativa indica una sostanziale sovrapposizione tra i costrutti misurati dalle due valutazioni, a sostegno della validità del CLRA come misura del ragionamento logico e astratto. Inoltre, questo risultato è in linea con ricerche precedenti che collegano le prestazioni nei compiti di ragionamento alle capacità cognitive generali.

Tabella 1: Correlazione tra il Core Logical Reasoning Assessment e l'ICAR-16

Per quanto riguarda il Core Numerical Reasoning Assessment (CNRA) e il Core Verbal Reasoning Assessment (CVRA), le analisi di validità convergente non sono ancora state completate. Trattandosi di valutazioni di recente introduzione, queste misure sono ancora nelle prime fasi della raccolta di dati su larga scala. Stabilire prove di validità convergente per entrambe è una priorità assoluta nel nostro programma di ricerca e sono già stati pianificati studi per confrontare i punteggi CNRA e CVRA con misure consolidate di abilità cognitiva. Questi risultati saranno aggiunti alle future versioni del presente manuale tecnico, garantendo lo stesso livello di evidenza scientifica e trasparenza disponibile per il CLRA.

Differenze tra gruppi e simulazioni di impatto negativo

Differenze di gruppo

Sono stati condotti test t su campioni indipendenti per verificare se vi fossero differenze significative nei punteggi theta del CRA tra uomini e donne, tra soggetti di età inferiore o superiore ai 40 anni e tra individui bianchi e non bianchi. È stato inoltre calcolato il d di Cohen per comprendere in che misura tali differenze siano significative dal punto di vista pratico. Come illustrato nelle Tabelle 2, 3 e 4, non vi sono differenze statisticamente significative o praticamente rilevanti nei punteggi theta tra uomini e donne e tra rispondenti bianchi e non bianchi. È stata riscontrata una differenza statisticamente significativa tra i soggetti di età inferiore e superiore ai 40 anni; tuttavia, il d di Cohen suggerisce che tale differenza sia praticamente irrilevante.

Sebbene queste analisi non evidenzino alcuna differenza, o ne rilevino solo di minime, tra i gruppi, esse non individuano né confermano la presenza di un bias di valutazione. Per verificare empiricamente tale ipotesi, sono state condotte analisi dell'impatto negativo.

Tabella 2: Verifica delle differenze tra i gruppi nei punteggi CLRA Theta

Tabella 3: Verifica delle differenze tra i gruppi nei punteggi theta del CNRA

Tabella 4: Verifica delle differenze tra i gruppi nei punteggi theta del CVRA

Simulazioni di impatto negativo

L'impatto negativo (AI) può essere definito come «un tasso di selezione sostanzialmente diverso nelle assunzioni, nelle promozioni o in altre decisioni relative all'occupazione che va a svantaggio dei membri di una razza, di un sesso o di un gruppo etnico» (cfr. sezione 1607.16 delle Linee guida uniformi sulle procedure di selezione del personale; Commissione per le pari opportunità di lavoro, Commissione per il pubblico impiego, Dipartimento del Lavoro degli Stati Uniti, 1978). La “regola dei quattro quinti” può essere utilizzata per determinare se una valutazione abbia un impatto negativo. Nello specifico, quando “il tasso di selezione per qualsiasi razza, sesso o gruppo etnico che sia inferiore ai quattro quinti (4/5) (o all’ottanta per cento) del tasso del gruppo con il tasso più alto sarà generalmente considerato dalle agenzie federali preposte all’applicazione della legge come prova di impatto negativo” (1978, cfr. sezione 1607.4 D). Inoltre, dato che l’Age Discrimination in Employment Act stabilisce che le persone di età superiore ai 40 anni necessitano di protezione, le valutazioni non dovrebbero avere un impatto negativo sulle persone più giovani o più anziane (Age Discrimination in Employment Act del 1967).

Sebbene le analisi precedenti non abbiano evidenziato differenze tra i gruppi, o ne abbiano rilevate di minime, sono state condotte simulazioni basate sull’intelligenza artificiale (IA) della regola dei 4/5 per dimostrare ulteriormente che i punteggi CRA non incidono negativamente sui gruppi protetti. Per verificare la presenza di discriminazione automatizzata, abbiamo confrontato il tasso di selezione dei gruppi protetti (ad es. donne, persone di età superiore ai 40 anni e individui non bianchi) con quello dei gruppi non protetti (ad es. uomini, persone di età inferiore ai 40 anni e individui bianchi). Rapporti superiori o uguali a 0,80 indicano che la valutazione non presenta discriminazione automatizzata.

Utilizzando una soglia del 25%, abbiamo condotto simulazioni basate sull'intelligenza artificiale per tre dimensioni demografiche: età, genere ed etnia. La tabella 5 riporta i risultati della nostra analisi basata sull'intelligenza artificiale. In tutte le simulazioni, il rapporto di intelligenza artificiale è risultato pari o superiore a 0,80 per ciascuna scala e ciascun gruppo demografico.

Tabella 5: Simulazioni degli impatti negativi

Piano d'azione per il miglioramento e la convalida della valutazione

La suite Core Reasoning si basa su principi rigorosi, ma Deeper Signals si impegna a migliorarla costantemente. I futuri sforzi di ricerca e sviluppo si concentreranno su tre priorità fondamentali:

Creare valutazioni migliori, più eque e più rappresentative

Deeper Signals continuerà ad ampliare e perfezionare le banche dati di domande di Core Reasoning per migliorare la precisione e la sicurezza delle valutazioni. L'impegno si concentrerà su:

- Ampliare il bacino di domande ricorrendo a una combinazione di generazione automatica delle domande (logiche) e redazione delle domande assistita dall'intelligenza artificiale (numeriche e verbali), garantendo una copertura più ampia a tutti i livelli di abilità.

- Verifiche periodiche dell'equità, comprese analisi del funzionamento differenziale degli item (DIF) e simulazioni dell'impatto negativo, per garantire che le valutazioni rimangano eque tra i vari gruppi demografici in termini di età, genere, etnia e altri fattori.

- Ampliare i campioni normativi su diverse aree geografiche, settori e livelli di carriera, consentendo alle organizzazioni di disporre di parametri di riferimento più rappresentativi e di norme specifiche per ogni contesto.

L'obiettivo è quello di creare un'esperienza di valutazione in costante miglioramento, che non sia solo più accurata e sicura, ma anche equa e rappresentativa della variegata forza lavoro globale.

Studi di validazione per rafforzare la credibilità e la differenziazione

La ricerca di validazione continuerà a rafforzare la base di dati scientifici a sostegno della suite Core Reasoning, con due obiettivi complementari:

- Validazione a livello di suite: analisi del potere predittivo delle capacità di ragionamento generale (ovvero la competenza combinata in materia di ragionamento logico, numerico e verbale) rispetto a risultati professionali quali le prestazioni lavorative, la capacità di adattamento e il potenziale di leadership.

- Convalida a livello di faccetta: dimostrare il contributo predittivo specifico di ciascun ambito di ragionamento, evidenziando in che modo il ragionamento logico, numerico e verbale consenta di distinguere le diverse competenze professionali (ad esempio, risoluzione dei problemi, analisi quantitativa, comunicazione, processo decisionale strategico).

Affrontando il compromesso tra larghezza di banda e fedeltà, questi studi metteranno in luce sia l'ampiezza del ragionamento generale sia la specificità delle capacità di ragionamento individuali, fornendo alle organizzazioni informazioni fondate su dati concreti per le diverse decisioni relative alla gestione dei talenti.

Innovazione continua

Deeper Signals si impegna a esplorare nuove metodologie per migliorare la qualità e l'impatto delle proprie valutazioni. Tra le innovazioni previste figurano:

- Studi di validazione dell'intelligenza artificiale, volti a verificare se i modelli linguistici di grandi dimensioni siano in grado di simulare i modelli di risposta umani al fine di supportare la calibrazione degli item e la stima dei parametri.

- Modelli di valutazione dinamica che integrano dati aggiuntivi, come i tempi di reazione, per migliorare la precisione e individuare i modelli di risposta.

- Progettazione di valutazioni di nuova generazione, che sfrutta i progressi nell'intelligenza artificiale per generare nuovi tipi di domande, ridurre i rischi di esposizione e ampliare la copertura dei costrutti.

Queste iniziative garantiscono che la suite Core Reasoning rimanga all’avanguardia nell’innovazione, coniugando il rigore psicometrico con una tecnologia all’avanguardia.

Il CLRA è uno strumento di valutazione di recente introduzione e, a settembre 2025, il suo sviluppo e la sua validazione rappresentano ancora un processo continuo e iterativo. Al fine di migliorare costantemente l'utilità e la validità predittiva del CLRA, intendiamo attuare le seguenti iniziative:

- Ampliamento del pool di domande: genereremo e convalideremo regolarmente nuove domande di valutazione pensate per coprire uno spettro ancora più ampio di abilità cognitive, migliorando sia la precisione che l'accuratezza delle misurazioni cognitive.

- Miglioramento dei dati normativi: il nostro obiettivo è ampliare i nostri dati normativi, sviluppando standard più ampi, diversificati e rappresentativi. Questo impegno consentirà di definire parametri di riferimento affidabili in diverse regioni, per diversi ruoli professionali e a diversi livelli organizzativi.

- Calibrazione continua e verifica dell'equità: verrà effettuata una ricalibrazione costante degli strumenti esistenti al fine di garantire l'accuratezza delle misurazioni. Inoltre, analisi periodiche consentiranno di individuare e mitigare eventuali impatti negativi, assicurando il rispetto delle linee guida dell'EEOC e l'equità dei risultati delle valutazioni tra i diversi gruppi demografici.

- Ampliamento della ricerca di validazione: abbiamo in programma un'ampia ricerca di validazione volta a dimostrare la validità critica del CLRA. Ciò comprende la valutazione della capacità predittiva della valutazione in relazione alle prestazioni lavorative e ai principali risultati organizzativi in vari ruoli e settori.

Invitiamo vivamente alla collaborazione ricercatori e aziende interessati a migliorare il rigore psicometrico e l'impatto pratico del CLRA. Il nostro impegno è quello di migliorare costantemente il CLRA per rispondere al meglio alle diverse esigenze delle organizzazioni moderne e alle loro strategie di gestione dei talenti.

Riferimenti

Legge sulla discriminazione dell'età nell'impiego del 1967. , Pub. L. No. Pub. L. No. 90-202, e seguenti (1967).

Carpenter, P. A., Just, M. A. e Shell, P. (1990). Cosa misura un test di intelligenza: una descrizione teorica dei processi coinvolti nel test delle Matrici Progressive di Raven. Psychological Review, 97(3), 404.

Carroll, J. B. (1993). Le capacità cognitive umane: una rassegna degli studi di analisi fattoriale. Cambridge University Press.

Cattell, R. B. (1963). Teoria dell'intelligenza fluida e cristallizzata: un esperimento critico. Journal of Educational Psychology, 54(1), 1–22.

Chamorro-Premuzic, T., & Furnham, A. (2010). La psicologia della selezione del personale. Cambridge University Press.

Condon, D. M., & Revelle, W. (2014). La risorsa internazionale sulle capacità cognitive: sviluppo e validazione iniziale di uno strumento di misurazione di dominio pubblico. Intelligence, 43, 52-64.

Embretson, S. E., & Reise, S. P. (2013). Teoria della risposta all'item per psicologi. Psychology Press.

Equal Employment Opportunity Commission, Civil Service Commission, U.S. Department of Labor, & U. S. D. of J. (1978). Linee guida uniformi sulle procedure di selezione dei dipendenti. Registro federale, 43, 38290-38309.

Judge, T. A., Colbert, A. E. e Ilies, R. (2004). Intelligenza e leadership: una revisione quantitativa e una verifica delle ipotesi teoriche. Journal of Applied Psychology, 89(3), 542–552.

Raven, J., Raven, J. C. e Court, J. H. (1998). Manuale delle matrici progressive e delle scale di vocabolario di Raven. Oxford Psychologists Press.

Rust, J., Kosinski, M. e Stillwell, D. (2021). Psicometria moderna: la scienza della valutazione psicologica (4ª ed.). Routledge.

Sackett, P. R., Zhang, C., Berry, C. M. e Lievens, F. (2022). Una nuova analisi delle stime meta-analitiche della validità nella selezione del personale: affrontare la sovracorrezione sistematica dovuta alla restrizione dell'intervallo. Journal of Applied Psychology, 107(11), 2040–2068.

Schmidt, F. L., & Hunter, J. E. (1998). La validità e l'utilità dei metodi di selezione nella psicologia del personale: implicazioni pratiche e teoriche di 85 anni di risultati di ricerca. Psychological Bulletin, 124(2), 262–274.

Van der Linden, W. J., & van der Linden, W. (a cura di). (2016). Manuale di teoria della risposta all'item (Vol. 1). New York: CRC Press.

Zeidner, M. (1998). Ansia da esame: lo stato dell'arte. Plenum Press.